Seeing Far and Clearly: Mitigating Hallucinations in MLLMs with Attention Causal Decoding

(CVPR 2025 ORAL)

motivation

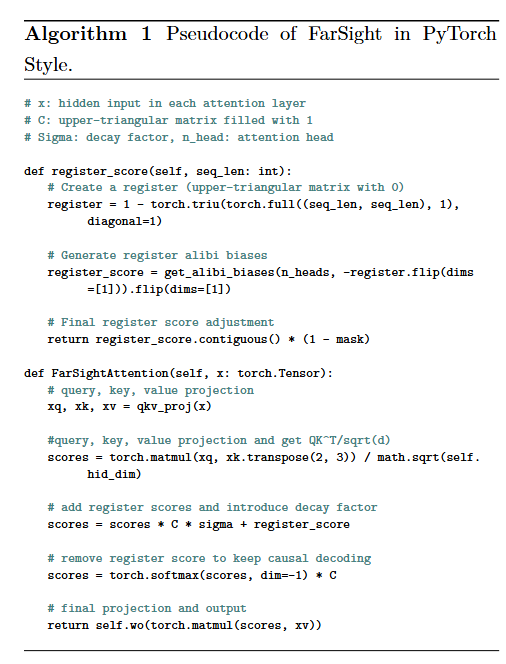

作者发现幻觉有两个来源:

注意力坍塌 (Attention Collapse):模型往往会将不成比例的超高注意力分配给信息量极低的“离群 Token”(outlier tokens),比如图像的背景或者文本的标点符号 。由于 Softmax 函数要求所有注意力分数总和必须为1,这些低信息量的 Token 抢占了过多注意力,阻碍了有效语义信息的传播 。

位置信息衰减 (Positional Information Decay):随着模型生成的文本越来越长,它对密集的视觉信息(图片/视频)的注意力会逐渐下降 。这是因为大模型常用的旋转位置编码(RoPE)具有长期衰减的特性,无法在长文本生成时维持视觉和文本 Token 之间的充分交互,导致模型“忘了”看图,从而产生幻觉 。

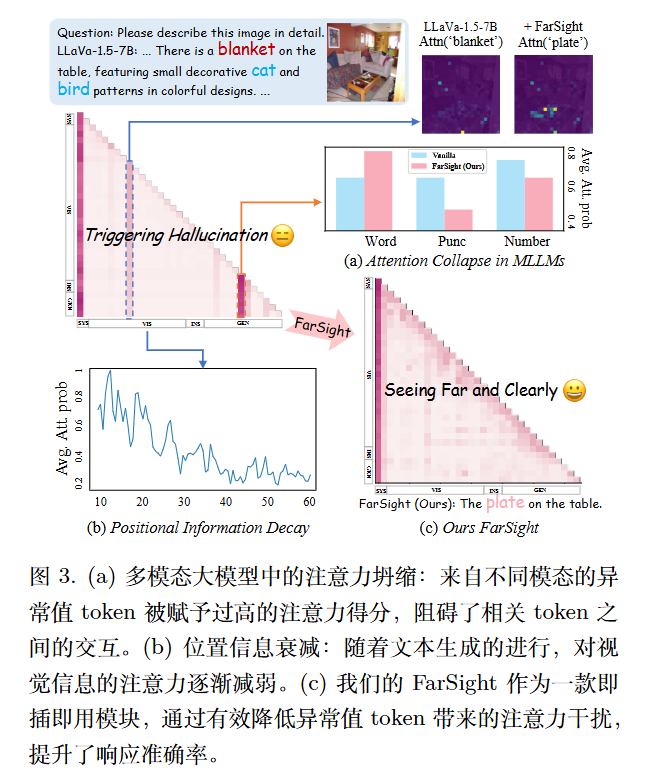

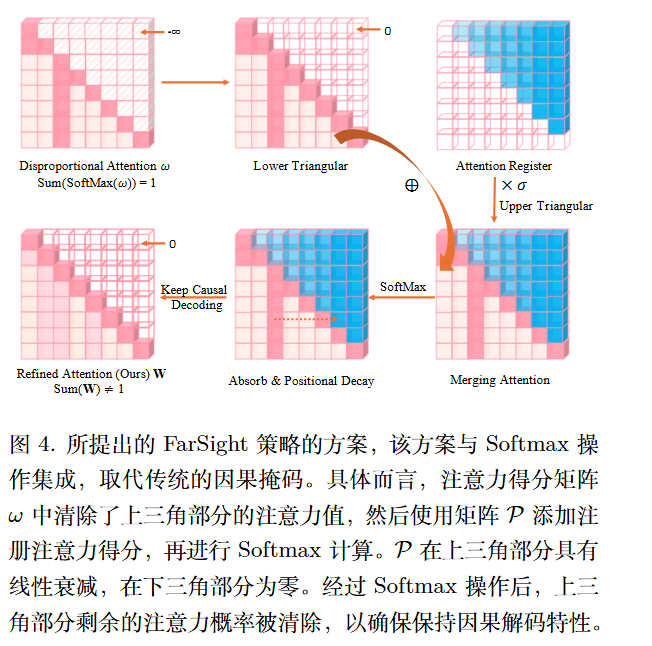

方法

构造寄存器矩阵 $\mathcal{P}$: 对于每一行 $i$,在上三角区域(即未来 Token 的位置 $j > i$)初始化一组寄存器分数:

$$\mathcal{P}_i = [0, 0, \dots, 0, \mathcal{P} _ {i,i+1}, \mathcal{P} _ {i,i+2}, \dots, \mathcal{P} _ {i,n}]$$

引入距离衰减惩罚: 为了符合注意力随距离衰减的规律,寄存器分数 $\mathcal{P} _ {i,j}$ 根据相对距离施加线性衰减惩罚($\sigma$ 为衰减率超参数):

$$\mathcal{P} _ {i,j} = -(j-i) \cdot \sigma, \quad \forall j > i$$

矩阵融合与 SoftMax 计算: 将原始注意力分数 $\omega$ 与寄存器 $\mathcal{P}$ 结合。为了确保 $\omega$ 只有下三角参与计算,引入了一个全 $1$ 的下三角矩阵 $C = \text{tril}(\mathbb{1} _ {n \times n})$ 。 融合后的计算公式为:

$$\tilde{W} = \text{SoftMax}(\omega \cdot C + \mathcal{P}) \cdot C$$